MIT’in İş Dünyasında Yapay Zeka Durumu raporu, kuruluşların %40’ının kurumsal büyük dil modeli (LLM) abonelikleri satın almasına rağmen, çalışanların %90’dan fazlasının günlük işlerinde yapay zeka araçlarını aktif şekilde kullandığını ortaya koyuyor. Harmonic Security’nin araştırması ise hassas yapay zeka etkileşimlerinin %45,4’ünün çalışanların kurumsal kontrolleri atlayarak kişisel e-posta hesaplarından gerçekleştiğini gösteriyor.

Çalışanlar Yapay Zeka Kullanımını Yönlendiriyor

Kuruluşlar genellikle yapay zeka kullanımını yukarıdan aşağıya, iş liderlerinin belirlediği bir süreç olarak görüyor. Ancak gerçek şu ki, çalışanlar denetimsiz bir şekilde yapay zekayı benimseyip kullanıyor; yönetişim ise hâlâ yukarıdan aşağıya tanımlanıyor. Kurumsal onaylı araçlar olsa bile, çalışanlar üretkenliklerini artırmak için başka yapay zeka çözümlerini tercih ediyor. Güvenlik ekipleri bu durumu fark etmez ve kontrol altına almazsa, işletme ciddi risklerle karşı karşıya kalıyor.

Engelleme Stratejisinin Sınırları

Birçok kurum, yapay zeka kullanımını engelleme yoluyla kontrol etmeye çalışıyor. Ancak yapay zeka artık sadece belirli platformlarla sınırlı değil; Canva, Grammarly gibi üretkenlik uygulamalarından, gömülü asistanlara sahip iş birliği araçlarına kadar pek çok SaaS uygulamasında entegre durumda. Engelleme, çalışanların kişisel hesaplar veya ev cihazları üzerinden alternatif araçlara yönelmesine neden oluyor ve gerçek kullanım görünürlüğünü engelliyor. İleri görüşlü güvenlik ekipleri ise çalışanların kullandığı araçları ve kullanım senaryolarını proaktif şekilde analiz ederek güvenli kullanımı destekliyor.

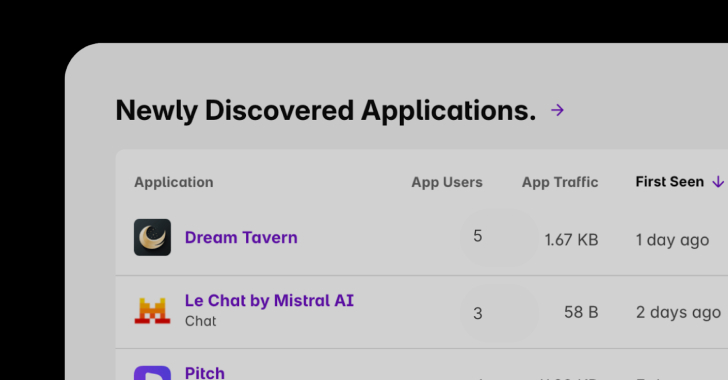

Gölge Yapay Zeka Keşfi ve Yönetişim Zorunluluğu

Yapay zeka varlıklarının envanteri, düzenleyici gereklilikler kapsamında zorunlu hale geliyor. AB Yapay Zeka Yasası gibi düzenlemeler, kuruluşların kullandıkları yapay zeka sistemlerine tam görünürlük sağlamasını şart koşuyor. Gölge yapay zeka keşfi, bu görünürlüğün temelini oluşturuyor. Farklı yapay zeka araçları farklı riskler barındırıyor; bazıları gizli veriler üzerinde eğitim yapabilir, bazıları ise yargı bölgelerine göre fikri mülkiyet riskleri taşıyabilir. Bu nedenle, hem kurumsal hem kişisel hesaplarda kullanılan yapay zeka araçlarının kapsamlı şekilde tespiti ve sınıflandırılması gerekiyor.

Harmonic Security’nin Yaklaşımı

Harmonic Security, çalışanların yapay zeka kullanımını izlemek için istihbarat tabanlı kontroller sunuyor. Statik engelleme listeleri yerine, onaylı ve onaysız yapay zeka kullanımlarına görünürlük sağlanıyor ve verinin hassasiyeti, çalışanın rolü ile aracın özelliklerine göre akıllı politikalar uygulanıyor. Örneğin, pazarlama ekibinin belirli içerikleri belirli araçlarda oluşturmasına izin verilirken, İK ve hukuk gibi hassas veri işleyen departmanlarda kişisel hesap kullanımı sınırlandırılıyor. Bu süreç, veriyi tanımlayan ve sınıflandıran yapay zeka modelleriyle destekleniyor.

Geleceğe Yönelik Strateji

Gölge yapay zeka kalıcı bir olgu olarak karşımızda duruyor. SaaS uygulamalarının yapay zekayı entegre etmeye devam etmesiyle, kontrolsüz kullanım artacak. Bugün keşif yapılmayan kurumlar, yarın etkili yönetişim sağlayamayacak. Bu nedenle engelleme yerine akıllı yönetişim stratejileri benimsenmeli. Gölge yapay zeka keşfi, CISO’lara hassas verileri koruma, düzenleyici uyumluluğu sağlama ve çalışanların yapay zekanın sunduğu üretkenlik avantajlarından güvenle faydalanmasını mümkün kılıyor. Harmonic Security, bu alanda kurumların bir sonraki adımı atmasına destek veriyor.