LangChain ve LangGraph gibi popüler yapay zeka geliştirme çerçevelerinde, dosyalar, gizli bilgiler ve veritabanları açığa çıkabiliyor. Bu zafiyetler, özellikle LLM tabanlı uygulamalar geliştiren yazılım ekiplerini ve kurumları etkiliyor. Siber güvenlik uzmanlarının, bu tür açıkları önlemek için kapsamlı önlemler alması gerekiyor.

Kategori: Yapay Zeka Güvenliği

Claude Eklentisinde Tıklamasız XSS İstismarıyla Kritik Güvenlik Açığı

Claude adlı yapay zeka asistan eklentisinde tıklama gerektirmeyen bir XSS (Cross-Site Scripting) açığı keşfedildi. Bu zafiyet, herhangi bir web sitesinin kullanıcı müdahalesi olmadan asistan aracılığıyla kötü niyetli istemler enjekte etmesine olanak tanıyor. Siber güvenlik uzmanları, özellikle web uygulamaları ve bulut tabanlı hizmetlerde çalışan ekiplerin bu tür saldırılara karşı önlem alması ger

Amazon Bedrock, LangSmith ve SGLang’de Kritik AI Güvenlik Açıkları ve Uzaktan Kod Çalıştırma Riskleri

Amazon Bedrock AgentCore, LangSmith ve SGLang platformlarında tespit edilen güvenlik açıkları, veri sızıntısı ve uzaktan kod çalıştırma gibi ciddi riskler barındırıyor. Bu zafiyetler, özellikle bulut tabanlı AI hizmetleri ve multimodal modellerde yetkisiz erişim ve kötü amaçlı komut yürütme imkanı sunuyor. Siber güvenlik ekipleri için bu tür yapay zeka altyapılarında ağ izolasyonu, IAM rol yönetim

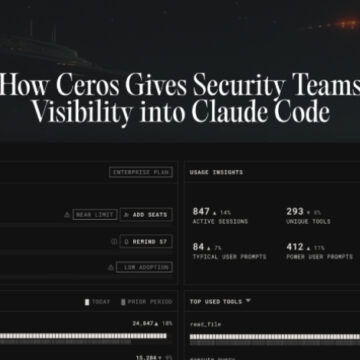

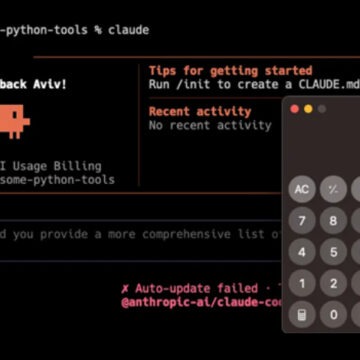

Claude Code’un Güvenlik Açığını Kapatmak İçin Ceros ile Çalışma Zamanı Görünürlüğü ve Kontrolü

Claude Code, geliştiricilerin makinelerinde otonom çalışan yapay zeka kodlama ajanı olarak mevcut güvenlik araçlarının denetim sınırlarını zorluyor. Ceros platformu, bu boşluğu kapatarak gerçek zamanlı görünürlük, çalışma zamanı politika uygulaması ve kriptografik denetim izi sunuyor. Siber güvenlik ekipleri için Claude Code etkinliklerinin tam takibini mümkün kılan bu çözüm, uyumluluk ve risk yön

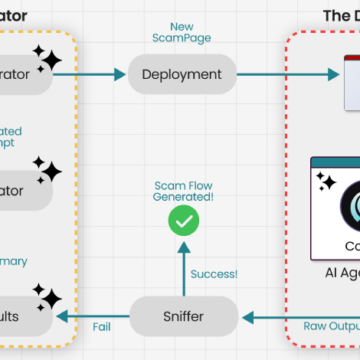

Perplexity Comet AI Tarayıcısına Karşı Gelişmiş Kimlik Avı Saldırıları ve Prompt Enjeksiyonları

Yapılan son analizler, Perplexity'nin Comet AI tarayıcısının dört dakikadan kısa sürede kimlik avı dolandırıcılığına maruz kaldığını ortaya koydu. Bu saldırılar, AI tarayıcıların davranışlarını manipüle eden gelişmiş prompt enjeksiyon teknikleriyle gerçekleştiriliyor ve özellikle AI ajanlarının insan gözetimi olmadan görev yapması durumunda riskler artıyor. Siber güvenlik profesyonelleri için bu d

Yapay Zeka Ajanlarında Kimlik Karanlık Maddesi ve Güvenli MCP Benimseme Stratejileri

Yapay zeka ajanlarının kurumsal ortamlarda hızlı benimsenmesi, kimlik karanlık maddesi olarak adlandırılan görünmez ve yönetilmez insan dışı kimlik risklerini artırıyor. Bu durum, özellikle Model Bağlam Protokolü (MCP) kullanan ajanların aşırı yetkilendirilmiş erişimlerle ve izlenmeyen kullanımla siber güvenlik açıklarına yol açmasına neden oluyor. Kuruluşların bu yeni kimlik sınıfını güvenli şeki

Çinli Yapay Zeka Şirketlerinin 16 Milyon Claude Sorgusuyla Model Kopyalama Girişimi

Son raporlara göre, üç Çin merkezli yapay zeka şirketi, sahte hesaplar ve ticari proxy ağları kullanarak Anthropic'in Claude modeline 16 milyondan fazla sorgu gönderdi. Bu distilasyon saldırıları, yapay zeka modellerinin yeteneklerinin yasa dışı şekilde çıkarılması ve ulusal güvenlik risklerinin artmasına yol açıyor.

Claude Code’da 3 Kritik Güvenlik Açığı: Uzaktan Kod Çalıştırma ve API Anahtarı Sızıntısı

Yapay zeka destekli Claude Code kodlama asistanında, uzaktan kod çalıştırma ve API anahtarı sızıntısına yol açan üç önemli güvenlik açığı tespit edildi. Bu zafiyetler, özellikle güvenilmeyen projelerin açılması durumunda kötü niyetli komutların çalıştırılmasına ve hassas verilerin dışa sızmasına imkan tanıyor. Siber güvenlik profesyonelleri için bu durum, yapay zeka destekli geliştirme ortamlarınd

GitHub Codespaces’ta RoguePilot Açığı: GITHUB_TOKEN Sızıntısına Yol Açan Yeni İstem Enjeksiyonu

GitHub Codespaces ortamında ortaya çıkan RoguePilot adlı güvenlik açığı, kötü niyetli aktörlerin Copilot aracılığıyla GITHUB_TOKEN gibi hassas bilgileri sızdırmasına imkan tanıyor. Bu yapay zeka destekli saldırı, GitHub sorunlarına gizlenen zararlı istemlerle otomatik kod yürütülmesini tetikleyerek özellikle geliştirici iş akışlarını hedef alıyor.

OpenClaw, ClawHub Becerilerinde Kötü Amaçlı Yazılımları Tespit İçin VirusTotal Entegrasyonu Sağladı

OpenClaw, ClawHub beceri pazarındaki kötü amaçlı yazılımların tespiti için VirusTotal ile entegre olarak yeni bir güvenlik katmanı oluşturdu. Bu gelişme, özellikle AI ajanlarının yeteneklerini kötüye kullanma riskine karşı kritik bir adım olarak öne çıkıyor. Ancak, uzmanlar bu taramanın tüm tehditleri yakalayamayabileceği konusunda uyarıyor.