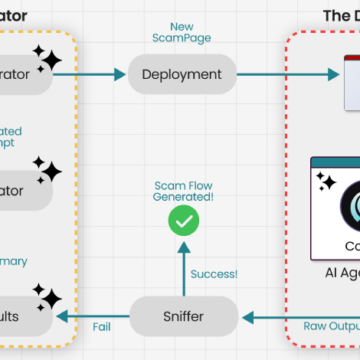

Yapılan son analizler, Perplexity'nin Comet AI tarayıcısının dört dakikadan kısa sürede kimlik avı dolandırıcılığına maruz kaldığını ortaya koydu. Bu saldırılar, AI tarayıcıların davranışlarını manipüle eden gelişmiş prompt enjeksiyon teknikleriyle gerçekleştiriliyor ve özellikle AI ajanlarının insan gözetimi olmadan görev yapması durumunda riskler artıyor. Siber güvenlik profesyonelleri için bu d

Etiket: Prompt Enjeksiyonu

OpenClaw, ClawHub Becerilerinde Kötü Amaçlı Yazılımları Tespit İçin VirusTotal Entegrasyonu Sağladı

OpenClaw, ClawHub beceri pazarındaki kötü amaçlı yazılımların tespiti için VirusTotal ile entegre olarak yeni bir güvenlik katmanı oluşturdu. Bu gelişme, özellikle AI ajanlarının yeteneklerini kötüye kullanma riskine karşı kritik bir adım olarak öne çıkıyor. Ancak, uzmanlar bu taramanın tüm tehditleri yakalayamayabileceği konusunda uyarıyor.

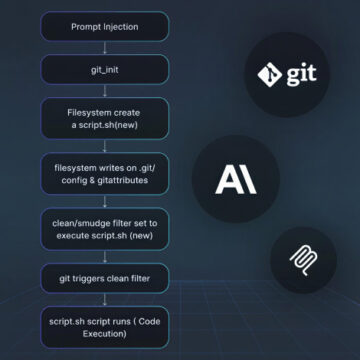

Anthropic MCP Git Sunucusunda 3 Kritik Güvenlik Açığı ve Uzaktan Kod Çalıştırma Riski

Anthropic tarafından geliştirilen MCP Git sunucusunda, Haziran 2025'te keşfedilen ve sorumlu açıklama sonrası giderilen üç önemli güvenlik açığı, uzaktan kod çalıştırma ve dosya sistemine yetkisiz erişim riskleri barındırıyor. Bu zafiyetler, yapay zeka asistanlarının okuduğu içeriklere yönelik prompt enjeksiyonu yoluyla istismar edilebiliyor ve geniş MCP ekosisteminde güvenlik incelemelerini zorun

Sıfır Tıklama Google Drive Saldırısı ve HashJack Prompt Enjeksiyonu: Yeni Tehditler ve Koruma Yöntemleri

Son analizler, sıfır tıklama ile çalışan bir tarayıcı saldırısının kullanıcıların Google Drive içeriklerini tamamen silebildiğini ortaya koyuyor. Ayrıca, yapay zeka destekli tarayıcı asistanlarını hedef alan HashJack adlı dolaylı prompt enjeksiyonu yöntemi de dikkat çekiyor. Bu gelişmeler, özellikle bulut güvenliği ve e-posta güvenliği alanlarında yeni riskler oluşturuyor.

30’dan Fazla AI Kodlama Aracında Veri Sızdırma ve Uzaktan Kod Çalıştırma Açıkları Keşfedildi

Yapay zeka destekli kodlama araçlarında, prompt enjeksiyonu yoluyla veri hırsızlığı ve uzaktan kod çalıştırma riskleri içeren 30'dan fazla güvenlik açığı tespit edildi. Bu zafiyetler, popüler IDE ve eklentilerini etkiliyor ve özellikle otomatik onaylı AI ajanlarının kötüye kullanımıyla saldırı yüzeyini genişletiyor. Siber güvenlik uzmanları, AI tabanlı geliştirme ortamlarında güvenlik önlemlerinin

ChatGPT Atlas Tarayıcısında Sahte URL’lerle Prompt Enjeksiyonu Güvenlik Açığı

ChatGPT Atlas tarayıcısında, sahte URL formatındaki girdilerle AI ajanlarının gizli komutları çalıştırmasına olanak tanıyan kritik bir güvenlik açığı tespit edildi. NeuralTrust ve diğer güvenlik araştırmacıları, prompt enjeksiyonlarının AI asistan tarayıcılarında sistemik bir sorun olduğunu ve saldırganların yeni yöntemlerle bu açığı kullanmaya devam ettiğini belirtiyor. OpenAI ve diğer firmalar, çok katmanlı güvenlik önlemleriyle bu tehditlere karşı mücadele ediyor.

Yapay Zekâ Güvenliği: Kritik Sistemlerde Agentic YZ ve En İyi Uygulamalar

Yapay zekâ sistemlerinin güvenliği, kimlik yönetimi ve çok katmanlı savunma mekanizmalarıyla sağlanmalıdır. Agentic YZ ajanlarının IAM çerçevesinde yönetilmesi, model zehirlenmesi ve prompt enjeksiyonu gibi tehditlere karşı etkili önlemler alınması kritik öneme sahiptir. Ayrıca, otomasyon ve insan denetimi arasında doğru denge kurularak güvenlik operasyonları optimize edilmelidir.

Cursor AI Kod Editöründe Workspace Trust Devre Dışı Bırakılması Güvenlik Açığına Yol Açıyor

Cursor AI kod editöründe Workspace Trust özelliğinin varsayılan olarak kapalı olması, kötü amaçlı depoların otomatik kod çalıştırmasına izin veren kritik bir güvenlik açığı oluşturuyor. Bu durum, tedarik zinciri saldırıları ve hassas veri sızıntıları riskini artırıyor. Uzmanlar, güvenlik önlemlerinin sıkılaştırılması ve kodların dikkatle incelenmesini öneriyor.