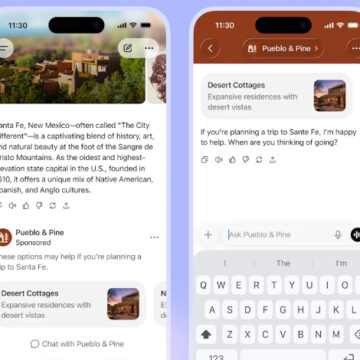

OpenAI, ABD’de 18 yaş üstü kullanıcılar için ChatGPT sohbet yanıtlarının altında reklam testlerine başladı. Reklamlar kullanıcı verileri gizli tutularak ve kişiselleştirme seçenekleri sunularak gösterilecek. Bu adım, şirketin abonelik dışı yeni gelir modelleri arayışının bir parçası olarak değerlendiriliyor.

Etiket: ChatGPT

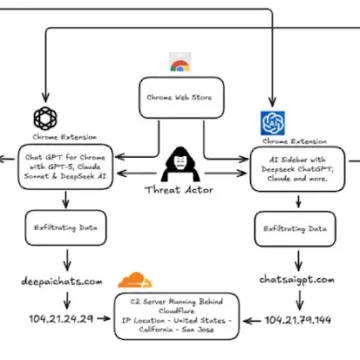

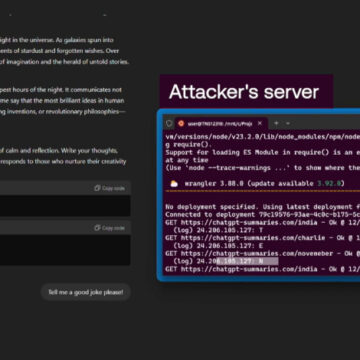

900.000 Kullanıcının ChatGPT ve DeepSeek Verilerini Çalan İki Kötü Amaçlı Chrome Uzantısı

Son analizler, ChatGPT ve DeepSeek sohbet içeriklerini ve tarama verilerini sızdıran iki kötü amaçlı Chrome uzantısının 900.000'den fazla kullanıcıyı etkilediğini ortaya koydu. Bu uzantılar, kullanıcıların sohbet verilerini ve açık sekme URL'lerini düzenli olarak saldırganların kontrolündeki sunuculara aktarıyor. Siber güvenlik profesyonelleri, benzer yöntemlerle çalışan meşru uzantılara karşı da

ChatGPT ve GPT-4o/5 Modellerinde Kritik İstem Enjeksiyonu Zafiyetleri ve Güvenlik Riskleri

Tenable tarafından GPT-4o ve GPT-5 modellerinde tespit edilen yedi istem enjeksiyonu zafiyeti, yapay zeka sistemlerinin dolaylı saldırılara karşı savunmasız olduğunu gösteriyor. Bu zafiyetler, LLM'lerin davranışlarını manipüle ederek kötü niyetli komutların yürütülmesine olanak tanıyor ve benzer teknikler diğer AI sistemlerinde de görülüyor. Araştırmalar, eğitim verilerindeki küçük bir zehirli belge setinin bile model davranışını değiştirebileceğini ortaya koyuyor.

Yapay Zeka Hedefli Gizleme Saldırısı: AI Tarayıcılarında Sahte Bilgi Manipülasyonu ve Güvenlik Riskleri

SPLX tarafından tanımlanan yapay zeka hedefli gizleme saldırısı, AI tarayıcılarına farklı içerik sunarak sahte bilgilerin doğrulanmış gerçekler gibi algılanmasına yol açıyor. hCaptcha Tehdit Analizi Grubu'nun raporları, bu ajanların SQL enjeksiyonu ve hesap ele geçirme gibi saldırıları kolaylıkla gerçekleştirebildiğini gösteriyor. Bu gelişmeler, yapay zeka tabanlı sistemlerin güvenilirliğini ciddi

ChatGPT Atlas Tarayıcısında Sahte URL’lerle Prompt Enjeksiyonu Güvenlik Açığı

ChatGPT Atlas tarayıcısında, sahte URL formatındaki girdilerle AI ajanlarının gizli komutları çalıştırmasına olanak tanıyan kritik bir güvenlik açığı tespit edildi. NeuralTrust ve diğer güvenlik araştırmacıları, prompt enjeksiyonlarının AI asistan tarayıcılarında sistemik bir sorun olduğunu ve saldırganların yeni yöntemlerle bu açığı kullanmaya devam ettiğini belirtiyor. OpenAI ve diğer firmalar, çok katmanlı güvenlik önlemleriyle bu tehditlere karşı mücadele ediyor.